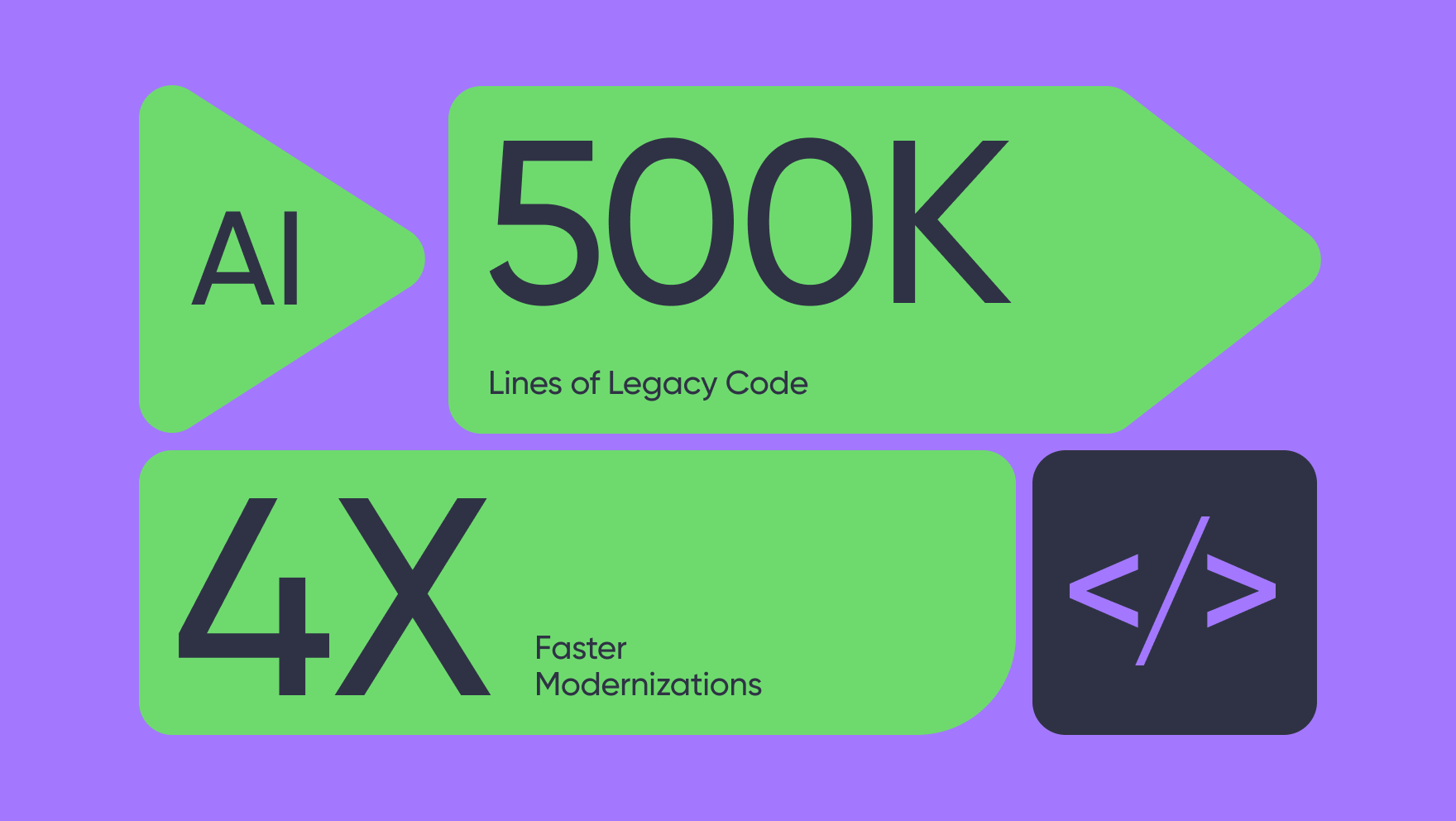

Legacy Code Modernisierung mit KI: 500.000 Zeilen – 4x schneller

Legacy-Frust beenden: Wir zeigen, wie KI 500k Zeilen Code in 8 Tagen knackt. Inklusive konkreter Prompt-Muster & operativer Guidelines! Unser Framework macht Modernisierung 4x schneller & eliminiert das Migrationsrisiko. Jetzt lesen, Vorlagen nutzen & effizient skalieren!

Legacy-Modernisierung klingt wie ein Technologieproblem. In Wirklichkeit beginnt sie als Sichtbarkeitsproblem.

Legacy-Systeme sterben selten laut. Sie laufen einfach weiter — Bestellungen, Transaktionen, Reports, Integrationen. Von außen: stabil. Von innen: ein Flickenteppich aus undokumentierter Logik, veralteten Kommentaren und Wissen, das mit den Kollegen gegangen ist, die das System mal gebaut haben.

Das eigentliche Problem ist nicht die Migration.

Es ist die Frage: Was tut dieses System eigentlich?

Ohne Antwort darauf werden aus Modernisierungsprojekten Ausgrabungen. Wochen verschwinden in Repositories, API-Traces und dem Vergleich von Dokumenten, die niemand mehr pflegt. Langsam, teuer, kaum steuerbar.

Und der Business-Druck? Der wartet nicht.

Anzeichen für kritischen Modernisierungsdruck:

- Die Wartungskosten steigen weiter

- Einige Spezialisten werden zu Engpässen

- Neue Funktionen brauchen zu lange, um zu liefern

- Integrationen mit modernen Plattformen sind schmerzhaft

- Compliance- und Sicherheitslücken nehmen im Laufe der Zeit zu

- Jede größere Veränderung fühlt sich riskant an

Warum Unternehmen modernisieren müssen:

- Senkung der Betriebskosten

- Beseitigung der Abhängigkeit von veralteten Technologien

- Sichtbarkeit und Steuerbarkeit der Geschäftslogik erhöhen

- Integration mit modernen Plattformen, APIs und Cloud-Diensten

- Verbesserung von Sicherheit, Governance und Compliance

- Beschleunigung von Produkt- und Prozessanpassungen

- Unterstützung neuer digitaler Services und Geschäftsmodelle

- Reduzierung langfristiger Transformationsrisiken

Das zentrale Spannungsfeld

Eine Migration ist notwendig, aber sie ist gleichzeitig riskant. In den meisten Legacy-Umgebungen besteht die eigentliche Herausforderung nicht im Neuschreiben des Codes. Die Schwierigkeit liegt darin, zu identifizieren, welches Systemverhalten weiterhin geschäftskritisch ist, welche Logik inzwischen veraltet ist und was in der neuen Architektur zwingend erhalten bleiben muss.

Die Frage ist also nicht, ob man modernisieren sollte. Die Frage ist, wie man das macht, ohne geschäftskritisches Verhalten zu verlieren und ohne Wochen oder Monate mit manuellem Reverse Engineering zu verbringen.

Der Case: 4-fache Beschleunigung durch KI-gestützte Analyse

In einem aktuellen WaveAccess-Projekt haben wir KI eingesetzt, um genau diese erste Phase zu beschleunigen. Nicht um "Code schneller zu schreiben", sondern um Geschäftslogik zu extrahieren, sie strukturiert zu dokumentieren, zu validieren und eine sicherere Grundlage für die Modernisierung zu schaffen.

Mit Claude Code haben wir in diesem Fall mehr als 8.000 Dateien und über 500.000 Zeilen Code und Konfiguration analysiert. Das Ergebnis:

- Dokumentation der Architektur und Kerngeschäftsprozesse

- Reduzierung des Analyseaufwands von 3–4 Wochen auf 7–8 Werktage

- Etwa 3–4-fache Beschleunigung gegenüber dem manuellen Ansatz

Dabei ist es wichtig, dass nicht das Werkzeug, also die KI, sondern der Methodenwechsel im Vordergrund steht!

Das alte Modell: „Manuelle Archäologie“

Die meisten Modernisierungsprojekte von Altsystemen (Legacy-Systemen) beginnen noch immer auf die gewohnte Weise:

- Fachbefragungen: Interviews mit Fachexperten führen.

- Code-Analyse: Quellcode manuell lesen.

- Datenbank-Check: Untersuchung von Datenbankschemata.

- Abgleich: Vergleich der tatsächlichen Implementierung mit veralteter Dokumentation.

- Reverse Engineering: Manuelle Rückentwicklung von APIs.

- Dokumentation: Festhalten der Erkenntnisse, während das Team lernt.

Die offensichtlichen Grenzen dieses Ansatzes:

- Selektive Abdeckung: Die Analyse bleibt lückenhaft.

- Qualitätsschwankungen: Das Ergebnis hängt stark vom jeweiligen Bearbeiter ab.

- Zeitdruck: Tiefgehende Analysen sind zeitlich kaum realisierbar.

- Verborgene Logik: Versteckte Abhängigkeiten werden leicht übersehen.

- Späte Überraschungen: Wichtige Sonderfälle (Edge Cases) werden oft erst viel zu spät entdeckt.

Genau das war das Problem, das wir vermeiden wollten.

Das neue Modell: KI-gestützte Extraktion

Der Paradigmenwechsel: Erst validieren, dann modernisieren

Der bessere Weg, über Modernisierung nachzudenken, ist dieser: Zuerst die Logik extrahieren und validieren. Dann modernisieren.

Dieser Ansatz beschreibt den Übergang von manuellen Code-Umschreibungen hin zu einer KI-gestützten, kontrollierbaren Generierung mit klaren Anweisungen, Checkpoints und Validierungsgates. Das Ziel ist nicht schnelleres Tippen, sondern ein steuerbarer, wiederholbarer Modernisierungsprozess.

In der Praxis hilft die KI bei Aufgaben, die Menschen in sehr großen Systemen nur schwer bewältigen können:

- Umfassende Analyse der Codebasis

- Systematische Extraktion von Metadaten

- Modulweise Dokumentation

- API-Rekonstruktion direkt aus der Implementierung

- Extraktion von Geschäftsprozessen

- Automatische Generierung von Diagrammen

- Abgleich von Dokumentation vs. tatsächlichem Code

- Repetitive, strukturierte Analysen in großem Maßstab

Das ersetzt keine Experten – es befreit sie von der "Archäologie" und lässt sie sich auf die neue Architektur konzentrieren.

Das eigentliche Ziel ist nicht die Code-Migration

Ein Altsystem (Legacy-System) ist nicht wegen seiner Syntax wertvoll, sondern wegen der darin eingebetteten Geschäftslogik. Diese Logik umfasst unter anderem:

- Routing-Regeln und Transaktionszustände

- Validierungspfade und Preislogik

- Integrationsverhalten und Exception Handling

- Datenmappings und Workflow-Verzweigungen

Wenn Sie den Code migrieren, aber die Logik verlieren, scheitert das Projekt. Wenn Sie die Logik bewahren, haben Sie Optionen: vollständige Transformation, schrittweise Migration, selektives Refactoring, Erneuerung der Benutzeroberfläche (UI) oder strategischer Erhalt stabiler Teile.

Das Modernisierungs-Framework macht dies explizit: Metadaten auf Code-Ebene extrahieren, diese in eine technologieunabhängige Geschäftsspezifikation umwandeln, validieren und erst dann die Ziellösung generieren.

Modernisierung als zweiphasiger Prozess

Phase 1: Extraktion und Bereinigung

- Analyse von Code, Schemata, Konfigurationen und Logs.

- Identifizierung realer Geschäftsabläufe.

- Trennung von aktiver Logik und veralteter Logik.

- Formalisierung der wichtigen Regeln.

- Validierung durch Fachexperten.

Phase 2: Generierung und Modernisierung

- Wahl der Zielarchitektur und Entwurf zukünftiger Module/APIs.

- Neuerstellung nur der Logik, die überdauern soll.

- Ergänzung aktueller Standards für UX, Integration, Sicherheit und Betrieb.

Fazit: Diese Reihenfolge ist entscheidend für den Erfolg jeder Modernisierungsinitiative.

Der Praxisfall: Eine komplexe Mixed-Stack-Legacy-Plattform

Das Projekt selbst war weder klein noch übersichtlich strukturiert. Es handelte sich um eine Unternehmensplattform mit mehreren Modulen und folgenden Merkmalen:

- Technologie-Mix: PHP, Java und JavaScript/React.

- Spezifische Logik: Eigene Datentransformationslogik.

- Vernetzung: Dutzende externe Integrationen.

- Veralteter Stack: Ein technisch überholter Unterbau.

- Regelbasierte Komplexität: Ein Großteil des Geschäftsverhaltens war in einer Rules-Engine implementiert, statt in sauber dokumentierten Services.

Bevor eine verantwortungsvolle Modernisierung geplant werden konnte, mussten wir erst einmal ein klares Verständnis davon wiederherstellen, wie das System tatsächlich funktioniert.

Wie wir die Arbeit organisiert haben

Dies war kein lockeres „Prompting auf gut Glück“, sondern ein kontrollierter Workflow. Der Kernprozess sah wie folgt aus:

- Zugriff: Zugriff auf Code und datenbankbezogene Assets.

- Vorbereitung: Erstellung von Dokumentationsvorlagen.

- Konfiguration: Einrichtung eines dauerhaften Projektkontexts in der CLAUDE.md.

- Strukturanalyse: Analyse der Projektstruktur.

- Modulare Dokumentation: Jedes Modul wurde separat dokumentiert.

- Datenbank-Analyse: Untersuchung der Datenbankstrukturen.

- Übergreifende Dokumentation: Erstellung modulübergreifender Unterlagen.

- Review: Durchführung von Prüf- und Klärungszyklen (Review).

- Finalisierung: Abschluss des Dokumentationspakets.

Dabei nutzten wir eine klare Dokumentationshierarchie:

Plattform-Architektur

└──── Modul-Architektur

└──── Komponentenbeschreibungen

└──── API-Referenz

└──── Geschäftsprozesse

Schritt 1: Die Umgebung professionell einrichten

Bevor wir die KI mit der Analyse beauftragten, haben wir die Umgebung wie ein Engineering-Team vorbereitet – nicht wie Redakteure.

Unsere Maßnahmen:

- Projektzugriff: Erhalt des Zugangs zum Projekt.

- Repository-Management: Klonen der Repositories.

- Konfiguration: Einrichtung von Claude Code.

- Strukturelle Erstanalyse: Durchführung eines ersten Struktur-Reviews.

- Modulgrenzen: Identifizierung der Modulgrenzen.

- Entry Points: Festlegung der zentralen Einstiegspunkte.

- Datenfluss: Mapping der Hauptdatenflüsse.

Zudem haben wir eine CLAUDE.md-Datei mit einer Basis-Projektbeschreibung erstellt. In der Praxis diente diese als dauerhaftes Projektgedächtnis über verschiedene Sessions hinweg. Sie speicherte das gesammelte Verständnis und verhinderte, dass derselbe Kontext immer wieder neu erklärt werden musste. Dieser eine Schritt war entscheidender, als es klingen mag: Bei großen Systemen ist die Kontinuität des Kontextes ein echter Qualitätsfaktor.

Schritt 2: Templates definieren, bevor Output generiert wird

Eine der klarsten Erkenntnisse aus dem Projekt war: Templates sind nicht optional. Ohne Vorlagen neigt KI-generierte Dokumentation dazu, folgende Schwächen aufzuweisen:

- Inkonsistenz

- Zu hohe Wortwahl (Verbosity)

- Schwere Vergleichbarkeit

- Mangelnde Navigierbarkeit

- Erschwertes Review

Ohne die Einschränkungen durch Templates kann die generierte Dokumentation so stark anwachsen, dass sie fast so groß wie die Codebasis selbst wird.

Wir haben verschiedene Template-Typen vorbereitet:

- Kompaktes Modul-Template: Beinhaltet eine „TL;DR“-Sektion, Modulrollen-Beschreibung, Tech-Stack, zentrale Constraints und Links zu Detail-Dokumenten.

- API-Beschreibung-Template: Beinhaltet Endpoint, Methode, URL, Request-Parameter mit Typen, Request/Response-Beispiele und Error-Codes.

- Geschäftsprozess-Template: Beinhaltet Kurzbeschreibung, Beteiligte (Systeme, Module), Step-by-Step-Flow und ein Sequenzdiagramm.

- Architecture Decision Record (ADR): Dokumentiert Kontext, Entscheidungen, Konsequenzen und Alternativen.

Unsere Leitprinzipien für den Output:

- Kürze: Fokus auf 150–300 Zeilen für Übersichts-Dokumente.

- DRY (Don’t Repeat Yourself): Verlinkungen statt Textwiederholungen.

- Beispiele: Jedes Konzept durch ein konkretes Beispiel untermauern.

- 80/20-Regel: Fokus auf die Informationen, die für 80 % der Fälle relevant sind.

Schritt 3: Mehr als nur den Quellcode nutzen

Einer der größten Fehler bei der Analyse von Altsystemen (Legacy-Systemen) ist die Annahme, dass der Anwendungscode die einzige Quelle der Wahrheit („Source of Truth“) sei. In der Praxis ist das selten der Fall.

Wir haben die Analyse daher um essenzielle Datenquellen ergänzt:

- Datenbankschema: Wir haben das Schema direkt exportiert und analysiert, unter anderem mit Befehlen wie:

pg_dump --schema-only -d database_name > schema.sqlDies half uns, Beziehungen aufzudecken, die im Code nicht offensichtlich waren, das reale Datenmodell zu klären und ungenutzte Felder sowie Tabellen zu identifizieren. - Datenbank-Dumps in Docker: Für eine tiefere Untersuchung haben wir einen Dump in einem isolierten PostgreSQL-Container wiederhergestellt:

docker run -d --name db-analysis -e POSTGRES_PASSWORD=secret postgres:15 docker exec -i db-analysis psql -U postgres < dump.sqlDas ermöglichte uns Analysen auf SQL-Ebene, ohne das Produktivsystem zu berühren. - Bash- und SQL-Probes: Wir nutzten einfache Befehle für schnelle Strukturprüfungen, zum Beispiel:

psql -c "SELECT type, COUNT(*) FROM rules GROUP BY type ORDER BY count DESC" grep -r "routing" config/ | wc -lSolche Checks waren extrem nützlich, um Regeltypen zu zählen, Konfigurationsmuster zu finden und Annahmen blitzschnell zu validieren. - Produktions-Logs: Identifizierung von aktiven Ausführungspfaden, häufig aufgerufenen Endpunkten, wiederkehrenden Fehlern, realen Parameterwerten und „totem“ Code.

Die wichtigste Erkenntnis: Code- und Datenbankstrukturen lügen nicht. Kommentare und alte Dokumentationen hingegen oft schon.

Schritt 4: Struktur abfragen, nicht nur Zusammenfassungen

Gute KI-Nutzung bedeutet, gezielte Fragen an die Struktur zu stellen. Wir haben spezifische Prompt-Muster entwickelt, die weit über einfaches "Zusammenfassen" hinausgehen.

Wir haben die KI gezielt für Aufgaben wie diese eingesetzt:

- Analyse der Modulstruktur:

Analyze the structure of the module located in /path/to/module.Identify:- Primary entry points (API endpoints, CLI commands)- Key classes and their responsibilities- Dependencies on other modulesUse the template from docs/templates/module-template.md. - API-Dokumentation:

Document all public API endpoints of the module.For each endpoint, specify:- HTTP method and path- Request parameters with types- Response structure- Possible errorsProvide real request/response examples from the code. Use the template from docs/templates/api-template.md. - Beschreibung von Geschäftsprozessen:

Describe the complete payment processing flow from initiation to completion.Include:- All participating systems- Data passed at each step- Possible branches (success / error / retry)- A Mermaid sequence diagramBase the description on actual code, not assumptions. Use the template from docs/templates/api-template.md. - Datenbank-Analyse:

Analyze the database schema from schema.sql.Identify:- Core entities and their relationships- Which tables belong to which subsystems- Patterns (soft deletes, audit fields, etc.)Create an ER diagram in Mermaid format. - Abgleich (Dokumentation vs. Code):

Compare the description in /docs/api.md with the actual implementation in /src/api/.Identify discrepancies between the documentation and the code

Die goldene Regel: Je strukturierter die Anfrage und je klarer der Bezug auf vorhandene Templates, desto präziser das Ergebnis.

Schritt 5: Das Tool wie einen Entdecker („Explorer“) nutzen

Der entscheidende Vorteil von Claude Code war die Fähigkeit zur autonomen Exploration. Statt Code manuell zu kopieren, agiert das Tool wie ein vollwertiges Teammitglied im Filesystem.

Claude Code verfügt über integrierte Fähigkeiten wie:

- Glob: Gezielte Dateisuche nach komplexen Mustern.

- Grep: Inhaltssuche über die gesamte Codebasis hinweg.

- Read: Direkte Inspektion und Korrelation von Dateien.

Dieses Setup lässt sich durch RAG-Systeme (Retrieval-Augmented Generation) erweitern, was die Methode unabhängig von einem spezifischen Produkt macht. Wichtig dabei: Spezialisierte Agenten und Plugins funktionieren nur dann optimal, wenn ihre Rolle explizit in der CLAUDE.md definiert ist.

Schritt 6: Große Aufgaben konsequent zerlegen (Dekomposition)

Kontextlimits sind eine reale technische Grenze. Große Dateien und komplexe Module passen nicht ohne Weiteres in den Kontext eines Modells. Claude Code bewältigt dies teilweise durch Zusammenfassungen, schrittweises Lesen und Agenten-basierte Zerlegung, aber wir mussten die Arbeit dennoch sorgfältig strukturieren.

Was am besten funktioniert hat:

- Das System strikt nach Modulen aufteilen.

- Mit kurzen, abstrakten Übersichten beginnen.

- Details erst schrittweise ausbauen.

- Beständiges Wissen konsequent in der CLAUDE.md zwischenspeichern.

- Abgegrenzte Unteraufgaben konsequent delegieren.

Dies verhinderte einen „Kontext-Overflow“ und verbesserte die Qualität des Outputs erheblich. Zudem wurde so die parallele Analyse unabhängiger Module erst machbar.

Schritt 7: Verborgene Logik in visuelle Artefakte verwandeln

Manche Logik ist visuell einfacher zu prüfen als durch Text. In unserem Workflow haben wir Mermaid-Diagramme genutzt, die direkt aus der Code-Analyse generiert wurden, darunter:

- Sequenzdiagramme

- ER-Diagramme (Entity-Relationship)

- Datenfluss-Mapping

Besonders wertvoll war dies für „unsichtbare“ Transformationslogik: spezifische Format-zu-Format-Mappings, die selbst für Menschen schwer zu rekonstruieren sind. In diesen Fällen ließen wir die KI die Transformation Schritt für Schritt erklären, Tabellen für das Field-Mapping erstellen und den Fluss visualisieren. Das machte schwer fassbares Systemverhalten endlich reviewbar.

Was wir entdeckt haben: Die harten Fakten

An diesem Punkt wurde der Mehrwert konkret. Unsere KI-gestützte Analyse deckte Details auf, die bei einer manuellen Prüfung fast sicher übersehen worden wären:

- Komplexität: Über 20.000 Routing-Regeln in einem Mix aus Rules-Engine und PostgreSQL.

- Zustände: Mehr als 60 verschiedene Transaktionszustände in der State Machine.

- Source of Truth: Eindeutige Belege, dass Datenbank und Code die einzigen verlässlichen Quellen der Wahrheit waren.

- Zahlreiche Fälle, in denen Kommentare und alte Dokumentationen nicht mehr mit der tatsächlichen Implementierung übereinstimmten.

Diese Erkenntnisse haben direkt beeinflusst, welche Teile des Altsystems wir erhalten, welche wir vereinfachen und welche veralteten Annahmen wir endgültig verwerfen konnten.

Ergebnisse in Zahlen

Die Projektkennzahlen sprechen für sich.

Analysierter Umfang:

- 8.000+ Dateien

- 500.000+ Zeilen Code und Konfiguration

Zeitaufwand im Projekt:

- 4–5 Arbeitstage: Aktive, KI-gestützte Arbeit.

- 2–3 Arbeitstage: Reviews, Validierung und finale Anpassungen.

- 7–8 Arbeitstage insgesamt.

Vergleich: Eine traditionelle Schätzung für denselben Analyseumfang liegt bei ca. 3–4 Wochen reinem Analysten-Aufwand.

KI-Ressourcenverbrauch & Effektivität:

- 2–3 Mio. Input-Token / 400-500k Output-Token

- 80–150 $ geschätzte API-Kosten

- Etwa 3- bis 4-mal schneller als der rein manuelle Prozess

Direkter Vergleich: Traditionell vs. KI-gestützt

| Aspekt | Traditioneller Ansatz | Mit KI (WaveAccess Methode) |

|---|---|---|

| Zeitaufwand | 3–4 Wochen | 7–8 Tage |

| Abdeckung | Selektiv (Stichproben) | Systematisch (Vollständig) |

| Konsistenz | Abhängig vom Autor | Einheitlich (durch Templates) |

| Analysetiefe | Zeitlich begrenzt | Gesamte Codebasis |

Was nicht automatisch funktioniert hat

Es wäre ein Fehler, den Prozess zu romantisieren. KI-gestützte Modernisierung erfordert Disziplin und menschliche Expertise. Hier ist eine Liste wiederkehrender Probleme, die sich mit unseren praktischen Erfahrungen decken:

- Halluzinationen: Gelegentliche technische Ungenauigkeiten (z. B. Verwechslung von PostgreSQL mit MySQL) erfordern eine gezielte fachliche Validierung.

- Toter Code: Veralteter Legacy-Code im Repository wird von der KI oft als relevant eingestuft. Die Lösung: Logs, Konfigurationen und die tatsächlichen Ausführungspfade gegenprüften.

- Kontext-Druck: Zu große Dateien führen zu sinkender Qualität. Eine konsequente Dekomposition (Zerlegung) ist unumgänglich.

Wir empfehlen einen expliziten Refinement-Zyklus:

- Dokument durch KI generieren lassen.

- Review durch Fachexperten durchführen.

- Ungenauigkeiten markieren und gezielte Rückfragen an die KI stellen.

- Dokument aktualisieren und Prozess ggf. 1–2 Mal wiederholen.

Security First: Sicherheit und lokale Modelle

Für Unternehmen ist dieser Teil oft entscheidender als die reine Zeitersparnis. KI-gestützte Modernisierung muss zwingend einem Security-First-Ansatz folgen. Unser Modernisierungs-Framework legt darauf besonderen Wert – und das ist die einzig richtige Haltung.

Sicherheitsmaßnahmen im Framework:

- Cleanup: Vollständiges Entfernen von Secrets und Hardcoded Credentials (keine Passwörter oder API-Keys in Prompts)vor der Analyse.

- Datenminimierung: Austausch mit dem Modell auf das absolute Minimum beschränken.

- Human-in-the-loop: Jede KI-Ausgabe wird von einem Menschen kontrolliert.

- Governance: Strikte Zugriffskontrollen und Prompt-Designs sind fester Teil des Lieferprozesses.

Wichtig für regulierte Branchen: Die Methode ist tool-unabhängig. In hochsensiblen Umgebungen setzen wir auf lokale oder selbstgehostete Modelle, damit der Quellcode die kontrollierte Infrastruktur niemals verlässt.

Die Kette bleibt identisch: Extraktion → Validierung → Dekomposition → Review → Modernisierung.

Was wir anderen Teams empfehlen würden: Operative Guidelines

Die abschließenden Empfehlungen aus diesem Praxisfall sind operativ, nicht theoretisch – und genau deshalb so wertvoll für Ihre Projekte:

- Mit Templates starten: Konsistenz ist das Fundament für verwertbare Ergebnisse.

- Dauerhafter Projektkontext: Wissen zwischen den Sessions erhalten.

- Bewusstes Kontextmanagement: Füttern Sie die KI gezielt, statt sie mit Daten zu überfluten.

- Mehr als nur Code nutzen:: Beziehen Sie Datenbank-Schemata, Dumps, Logs und Konfigurationen aktiv ein.

- Iterationen fest einplanen: Der erste Entwurf ist der Startpunkt, nicht das Ziel.

- Kritisches Review: Validieren Sie KI-Ergebnisse immer fachlich.

- Frühzeitige Dekomposition: Zerlegen Sie große Aufgaben sofort in handliche Häppchen.

- Beweispflicht: Fordern Sie Belege im Code ein ("Deep Dive"), statt sich mit Zusammenfassungen zu begnügen.

- Visualisierung nutzen: Setzen Sie Mermaid-Diagramme ein, um komplexe Logik lesbar zu machen.

- Governance: Betrachten Sie den gesamten Prozess als kontrollierten Business-Workflow.

Abschließendes Fazit: Modernisierung ohne Black-Box-Risiko

Die wichtigste Erkenntnis: KI schreibt nicht nur schneller Code – sie macht komplexe Altsysteme (Legacy-Systeme) um ein Vielfaches schneller verständlich.

Das verändert die gesamte Wirtschaftlichkeit von Modernisierungsprojekten. Sobald die verborgene Logik extrahiert, strukturiert und validiert ist, können Teams fundierte Architekturentscheidungen treffen – mit weniger Mutmaßungen und einem deutlich geringeren Migrationsrisiko.

Egal ob mit Claude Code oder anderen Tools: Mit den richtigen Templates und einer disziplinierten Review-Kultur verwandelt KI die Modernisierung von einer riskanten "Black-Box" in ein steuerbares Transformationsprogramm. Das verändert die gesamte Wirtschaftlichkeit von IT-Projekten nachhaltig.

Sie stehen vor einer ähnlichen Herausforderung? Lassen Sie uns gemeinsam schauen, wie wir Ihr Legacy-System effizient in die Zukunft führen.